Signal是否有青少年模式?深度解析隐私与安全平衡之谜

目录导读

- 引言:当“隐私天堂”遇上“青少年保护”

- 一个问题引发的思考:为什么我们关心Signal的青少年模式?

- 信号(Signal)的承诺:绝对隐私 vs. 社会责任的冲突。

- 核心解读:Signal真的有“青少年模式”吗?

- 官方功能清单:一个“无”字的背后逻辑。

- 替代方案:Signal有哪些内置的安全与限制功能?

- 深层博弈:为何Signal选择不内置“青少年模式”?

- 技术哲学:端到端加密的“双刃剑”。

- 商业模式:不收集数据,如何“识别”青少年?

- 道德困境:家长监控权与青少年隐私权的拉锯。

- 行业对比:主流社交平台如何做?Signal的差异化在哪?

- 微信、抖音、Instagram的“青少年模式”功能矩阵。

- 对比分析:Signal的“自由”与“风险”并存。

- 实操指南:家长如何在没有“青少年模式”的Signal上保护孩子?

- 设备层面的解决方案(iOS/Android屏幕时间)。

- 沟通与教育:比技术更重要的防线。

- 问答环节:关于Signal与青少年安全的五个核心疑问

- Q1: 如何限制孩子使用Signal的时间?

- Q2: Signal会推出自己的“青少年模式”吗?

- Q3: 孩子用Signal和陌生人聊天,我能看到吗?

- Q4: Signal相比微信,哪个更适合未成年人使用?

- Q5: 如果我要举报Signal上的不良内容,该怎么做?

- 技术的底线是人性,而不是功能

引言:当“隐私天堂”遇上“青少年保护”

在即时通讯领域,Signal一直是一个特立独行的存在,它因“端到端加密”、“零数据收集”和“完全开源”而成为全球记者、活动家及隐私倡导者的首选,当我们将目光投向“青少年”这一特殊群体时,一个尖锐的问题便浮现出来:这样一个以绝对隐私为信仰的软件,是否拥有“青少年模式”?

答案可能让许多家长感到失望:Signal目前没有,并且短期内大概率不会推出传统意义上的“青少年模式”。 但这并不意味着Signal在未成年人保护上无所作为,我们需要深入理解,为什么是这个“没有”,以及在没有“青少年模式”的情况下,我们还能做些什么。

这并非一个简单的功能缺失问题,而是一场关于隐私、安全、责任与技术哲学的深度博弈。

核心解读:Signal真的有“青少年模式”吗?

官方功能清单:

在Signal的设置菜单中,你找不到“青少年模式”或“家庭守护”的选项,没有针对特定年龄段的“观看时长限制”、“内容过滤”、“消费限额”或“联系人白名单”等功能。

替代方案:

Signal虽然没有所谓的“青少年模式”,但它内置了一些面向所有用户,且对青少年尤其重要的安全与限制功能,这些功能构成了其独特的安全防线:

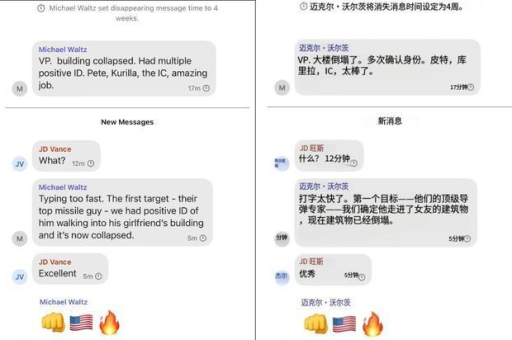

- 消失的消息: 用户可以设置消息在发送后5秒至4周内自动删除,这对防止青少年聊天记录被截屏或被他人窃取有积极作用,但也加大了家长追踪问题的难度。

- 截图通知: 当对方对聊天进行截屏时,发送方会收到通知,这在一定程度上威慑了不当内容的传播。

- 安全号码验证: 用户可以通过扫描二维码或比对数字来验证聊天对象是否就是本人,这能有效防止中间人攻击或账号被冒用。

- 屏蔽与举报: Signal提供了对骚扰用户进行屏蔽和向官方举报的功能,Signal会审查不当内容(如图片、文件),尽管加密限制使其审查能力有限。

- 注册锁: 防止他人通过短信验证码盗用你的Signal账号,增强了账户安全性。

Signal的逻辑是:不通过中央服务器识别并限制青少年,而是信任用户(及其监护人)自行管理风险。

深层博弈:为何Signal选择不内置“青少年模式”?

要理解Signal的决策,必须从它的核心原则出发:

技术哲学:端到端加密的“双刃剑” Signal无法读取任何用户的消息内容、文件或聊天列表,一个传统的“青少年模式”需要平台知道“谁是青少年”,并扫描其发送的文本、图片、视频以判断是否存在违规内容,但这与端到端加密背道而驰,Signal宁可牺牲部分监管能力,也要捍卫“内容绝对不可见”的承诺。

商业模式:不收集数据,如何“识别”青少年? 微信或抖音之所以能轻松推出青少年模式,是因为它们拥有极其详尽的用户画像,包括真实年龄、生日、所在学校、家庭关系等,Signal拒绝收集任何个人信息,在它看来,“用户年龄”本身也是一项它不该知道的敏感数据,它没有年龄数据库,因此无法精准地将“青少年模式”功能推送给特定人群。

道德困境:家长监控权与青少年隐私权的拉锯 Signal的创始人坚信,所有人,包括青少年,都应享有通信自由,内置“青少年模式”可能会让家长或监护人获得过度的监控权限,侵犯青少年的隐私权,在Signal看来,更好的解决方案是家长教育孩子如何安全使用网络,而不是由中央服务器来监控孩子的一举一动。

行业对比:主流社交平台如何做?

| 功能 | Signal | 微信 | TikTok/抖音 | |

|---|---|---|---|---|

| 青少年模式 | 无 | 有(强干预) | 有(强干预) | 有(中等干预) |

| 使用时长限制 | 无 | 有 | 有 | 有 |

| 联系人限制 | 无 | 可设置 | 有(私信限制) | 有(私信限制) |

| 数据收集 | 零收集 | 收集大量数据 | 收集大量数据 | 收集大量数据 |

| 核心哲学 | 绝对隐私 | 全面控制 | 算法推荐+监管 | 社交+监管 |

很明显,Signal走的是与其他巨头截然不同的道路,它的“优势”在于极度的隐私保护,劣势则在于缺乏主动的内容安全干预机制。

实操指南:如何在没有“青少年模式”的Signal上保护孩子?

如果你仍然决定让孩子使用Signal,可以尝试以下“曲线救国”的方法,尤其是在设备层进行管理:

-

利用系统级“屏幕使用时间”功能(iOS/iPadOS):

- 限制应用使用时长: 在“屏幕使用时间”中,将Signal设置为“始终允许”之外的应用,并设定每天最多使用时间(例如30分钟)。

- 限制安装/删除应用: 禁止孩子自行安装或删除Signal,确保你作为父母能控制账户。

- 与隐私: 严格设置iTunes Store与App Store购买限制,禁止下载未满14+的应用。

-

利用Google Family Link(Android):

- 管理应用: 允许或阻止孩子安装Signal,并设置使用时间限制。

- 监控应用活动: 了解孩子每天在Signal上花了多少时间。

-

教育优先于技术:

- 沟通约定: 与孩子开诚布公地讨论在Signal上能聊什么,不能聊什么,不分享个人家庭住址、学校信息、银行卡号,不发裸露照片。

- 创建家庭群: 让你们都成为彼此Signal的联系人,定期在家庭群里互动,建立信任。

- “绿灯”与“红灯”: 告诉孩子,如果有人在Signal上发奇怪或让他/她不舒服的内容,有权立即“屏蔽”并“报告”,并且一定要告诉家长。

-

定期检查账户安全:

与孩子一起检查其Signal的“隐私”和“安全”设置,确保“注册锁”开启,“截图通知”开启。

核心建议: 如果你无法接受Signal这种高度自由的环境,且孩子自控力较差,建议优先使用带有成熟“青少年模式”的平台(如微信或抖音)进行初期社交,等孩子年龄稍大、具有判断力后,再逐步引入Signal。

问答环节:关于Signal与青少年安全的五个核心疑问

Q1: 如何限制孩子使用Signal的时间? A: Signal App本身没有此功能,你需要通过手机系统的“屏幕时间”功能(iOS/Android)来设置Signal的每日使用时长上限,这是目前唯一可靠的办法。

Q2: Signal会推出自己的“青少年模式”吗? A: 极小可能,除非Signal改变其核心的“零数据收集”和“端到端加密”原则,否则它无法在技术上识别青少年用户,推出强制性的、需要注册年龄的模式,会违背其创始团队的隐私理念。

Q3: 孩子用Signal和陌生人聊天,我能看到聊天内容吗? A: 不能。 端到端加密机制使得任何人,包括Signal官方,都无法看到聊天内容,你唯一能看到的是孩子每天在Signal上花费了多少时间,但你无法读到他们聊了什么,这也是Signal最让家长担心的地方。

Q4: Signal相比微信,哪个更适合未成年人使用? A: 取决于你的需求。

- 如果需要家长强力监控(如限制使用时长、过滤聊天内容、禁用陌生人聊天),微信的“青少年模式”显然更适合。

- 如果更看重通信的绝对隐私与安全(如家庭内部私密沟通、分享敏感信息),且家长有能力进行设备级管理,Signal是更好的选择,总体而言,对于15岁以下的孩子,微信更易控;对于15岁以上、有较强判断力、且重视隐私的青少年,Signal可作为补充。

Q5: 如果我要举报Signal上的不良内容(如儿童色情),该怎么做? A: 你可以直接通过Signal应用内的“举报”功能,将可疑内容的截图或ID发给Signal官方,Signal与美国国家失踪与受虐儿童中心(NCMEC)有合作,会依法处理这些报告,但请注意,由于加密,Signal能获取的证据非常有限,主要依赖用户的主动举报和文件哈希比对。

技术的底线是人性,而不是功能

Signal没有青少年模式,这不是功能的缺失,而是一种技术选择的必然结果,它选择了一条最尊重用户(包括青少年)隐私但也是最难走的路。

对于家长而言,这无疑增加了管理的复杂性,我们不能依赖一个“一键开启”的按钮来解决问题。真正的安全,永远来自现实世界中良好的亲子沟通、有效的数字素养教育,以及家庭内部明确的规则。

当Signal因坚持完美隐私而无法提供“青少年模式”时,它其实是在提醒我们:在数字时代,保护孩子的责任,最终要回归到我们自己身上。